liteLLM

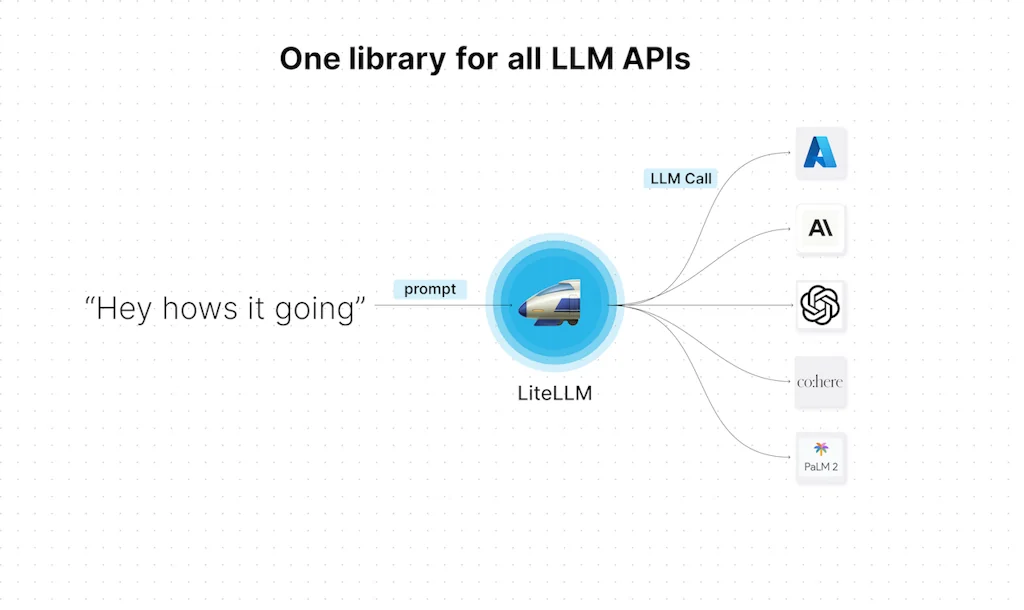

Una biblioteca para estandarizar todas las API de LLM

¿Qué es liteLLM?

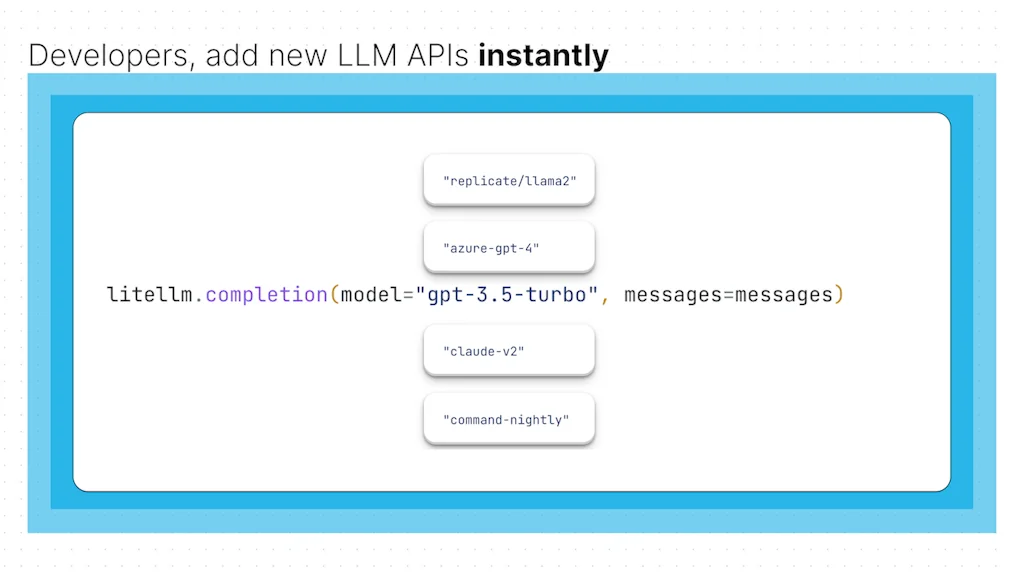

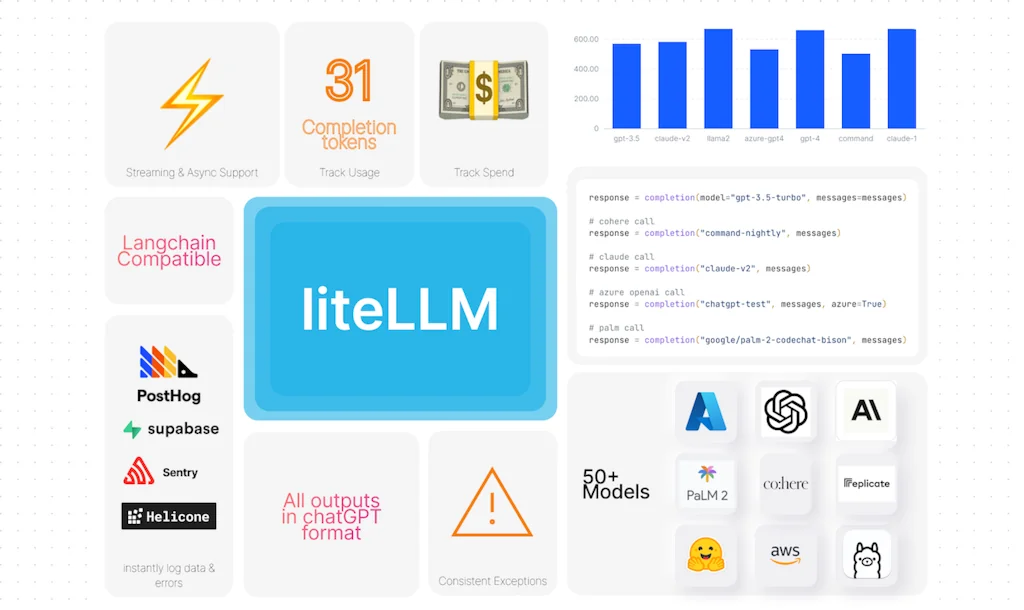

Simplifique el uso de las API de OpenAI, Azure, Cohere, Anthropic, Replicate y Google LLM. TLDR Llame a todas las API de LLM utilizando el formato chatGPT: finalización (modelo, mensajes) Salidas consistentes y excepciones para todas las API de LLM Registro y seguimiento de errores para todos los modelos

Pros y contras

Pros

- Soporte para modelos personalizados

- Almacenamiento en caché y equilibrio de carga

- Fácil cambio de proveedor

- API compatible con OpenAI

- Integración del análisis de rendimiento

- API estandarizada

- Interfaz unificada para LLM

- Llamadas API versátiles

Detalles de la herramienta

| Categorías | API unificada, Herramientas de infraestructura de IA |

|---|---|

| Sitio web | github.com |

| Añadido | 9 de agosto de 2023 |

| Plataformas | Web |

| Redes sociales | Twitter · GitHub |

Reseñas recientes (4)

liteLLM es imprescindible para trabajar con diferentes modelos. Utilizamos diferentes modelos para diferentes tareas y subtareas. Con liteLLM, el código permanece exactamente igual y podemos concentrarnos en elegir las indicaciones y modelos correctos para la tarea.

Gran admirador de liteLLM: una API para OpenAI/Anthropic/Groq/etc. Hace que las pilas de varios modelos sean sencillas

Me encuentro recomendando esta biblioteca a desarrolladores de aplicaciones serios con tecnología LLM que intentan estandarizar su base de código unificando todas las API que utilizan. ¡Me encanta!

Utilizado como proxy LLM, permite el almacenamiento en caché y el equilibrio de carga entre múltiples servicios de IA (Groq, OpenRouter, etc.) e incluso local con Ollama. Utiliza una API compatible con OpenAI que permite (cuando podamos configurar la URL base) usarla en muchas aplicaciones o servicios. Lo uso configurado con Langfuse, que proporciona el análisis de rendimiento (monitoreo) de cada mensaje/sesión.

Preguntas frecuentes sobre liteLLM

¿Cuándo se hizo popular liteLLM?

liteLLM se hizo popular alrededor de 9 de agosto de 2023.

¿Cuáles son las principales ventajas de liteLLM?

Las principales ventajas de liteLLM incluyen: soporte para modelos personalizados, almacenamiento en caché y equilibrio de carga, fácil cambio de proveedor, API compatible con OpenAI, integración del análisis de rendimiento.

¿Cuál es la calificación general de liteLLM?

liteLLM tiene una calificación general de 5.0/5 basada en 17 reseñas de usuarios.

¿Qué tipo de herramienta es liteLLM?

liteLLM pertenece a las siguientes categorías: API unificada, Herramientas de infraestructura de IA.

Herramientas API unificada relacionadas

Herramientas Herramientas de infraestructura de IA relacionadas

Comparar liteLLM :

No te dejes engañar por videos falsos en redes sociales

El primer verificador de hechos del mundo para redes sociales. Pega cualquier enlace y obtén una puntuación de credibilidad instantánea con fuentes.

Probar FactCheckTool gratis