liteLLM

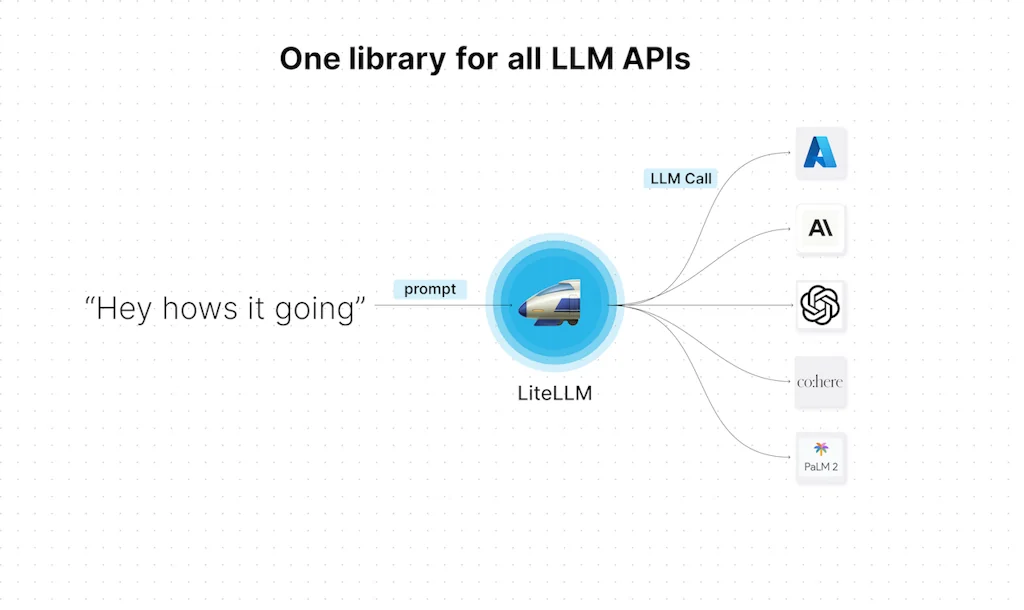

Una libreria per standardizzare tutte le API LLM

Cos'è liteLLM?

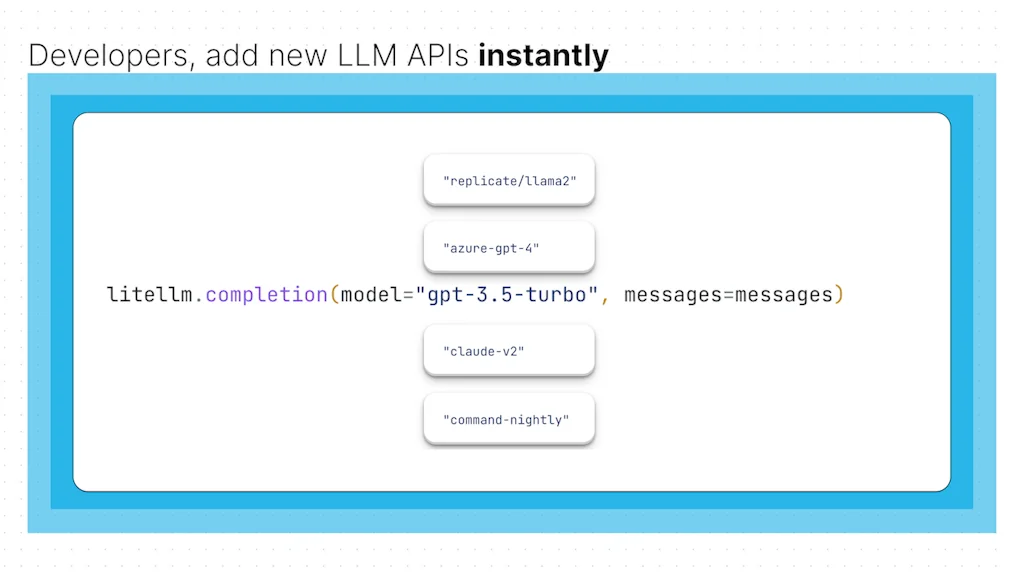

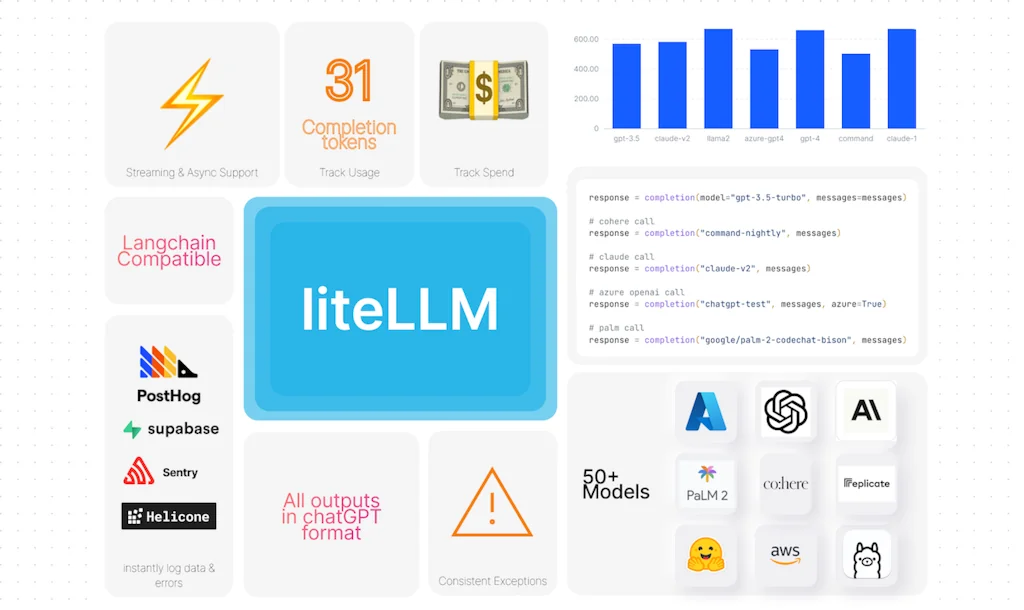

Semplifica utilizzando le API OpenAI, Azure, Cohere, Anthropic, Replicate e Google LLM. TLDR Chiama tutte le API LLM utilizzando il formato chatGPT - completamento (modello, messaggi) Output ed eccezioni coerenti per tutte le API LLM Registrazione e monitoraggio degli errori per tutti i modelli

Pro e contro

Pro

- Supporto per modelli personalizzati

- Memorizzazione nella cache e bilanciamento del carico

- Facile cambio di fornitore

- API compatibile con OpenAI

- Integrazione dell'analisi delle prestazioni

- API standardizzata

- Interfaccia unificata per LLM

- Chiamata API versatile

Dettagli dello strumento

| Categorie | API unificata, Strumenti per l'infrastruttura IA |

|---|---|

| Sito web | github.com |

| Diventato popolare | 9 agosto 2023 |

| Piattaforme | Web |

| Social media | Twitter · GitHub |

Recensioni recenti (4)

liteLLM è un must per lavorare con diversi modelli. Utilizziamo modelli diversi per compiti e sottoattività diversi. Con liteLLM il codice rimane esattamente lo stesso e possiamo concentrarci solo sulla scelta dei suggerimenti e dei modelli giusti per l'attività.

Grande fan di liteLLM: un'API per OpenAI/Anthropic/Groq/ecc. Rende indolori gli stack multi-modello

Mi ritrovo a consigliare questa libreria a seri sviluppatori di app basati su LLM che stanno cercando di standardizzare la propria base di codice unificando tutte le API che utilizzano. Lo adoro!

Utilizzato come proxy LLM, consente il caching e il bilanciamento del carico tra più servizi AI (Groq, OpenRouter, ecc.) e anche locale con Ollama. Utilizza un'API compatibile con OpenAI che consente (quando possiamo impostare l'URL di base) di utilizzarlo in molte app o servizi. Lo utilizzo configurato con Langfuse che fornisce l'analisi delle prestazioni (monitoraggio) di ogni prompt/sessione.

Domande frequenti su liteLLM

Quando è diventato popolare liteLLM?

liteLLM è diventato popolare intorno a 9 agosto 2023.

Quali sono i principali vantaggi di liteLLM?

I principali vantaggi di liteLLM includono: supporto per modelli personalizzati, memorizzazione nella cache e bilanciamento del carico, facile cambio di fornitore, API compatibile con OpenAI, integrazione dell'analisi delle prestazioni.

Qual è la valutazione complessiva di liteLLM?

liteLLM ha una valutazione complessiva di 5.0/5 basata su 17 recensioni degli utenti.

Che tipo di strumento è liteLLM?

liteLLM appartiene alle seguenti categorie: API unificata, Strumenti per l'infrastruttura IA.

Strumenti API unificata correlati

Strumenti Strumenti per l'infrastruttura IA correlati

Confronta liteLLM :

Non farti ingannare dai video falsi sui social media

Il primo verificatore di fatti al mondo per i social media. Incolla qualsiasi link e ottieni un punteggio di credibilità istantaneo con fonti.

Prova FactCheckTool gratis